Apple、オープンソースの学習・推論フレームワーク「OpenELM」を論文発表

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

AppleのMachine Learning Researchが、arXivにおいて「OpenELM: An Efficient Language Model Family with Open-source Training and Inference Framework」を論文発表しています。

大規模な言語モデルの再現性と透明性は、オープンな研究を推進し、結果の信頼性を確保し、データやモデルの偏りや潜在的なリスクの調査を可能にするために極めて重要です。この目的のために、Appleは、Hugging Faceにて最先端のオープン言語モデルである「OpenELM」をリリースしたと説明しています。

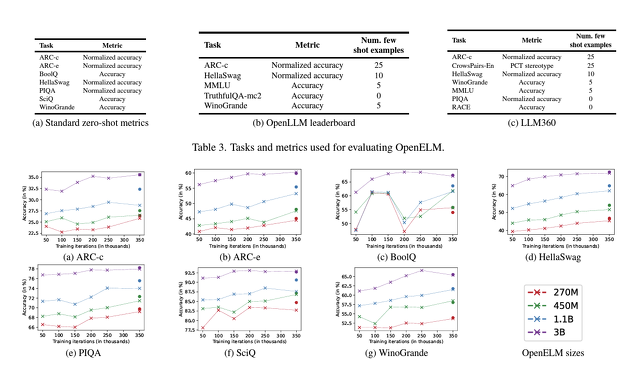

OpenELMは、レイヤーごとのスケーリング戦略を用いて、変換モデルの各レイヤーに効率的にパラメータを割り当てることで、精度を向上させています。例えば、約10億パラメータのパラメータバジェットで、OpenELMはOLMoと比較して2.36%の精度向上を示し、同時に2倍少ない事前学習トークンを必要とします。

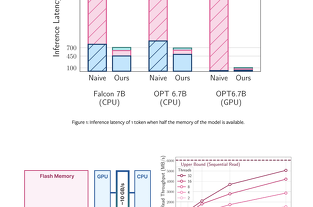

モデルの重みと推論コードのみを提供し、プライベートなデータセットで事前学習を行う先行事例とは異なり、OpenELMのリリースには、学習ログ、複数のチェックポイント、事前学習設定を含む、一般公開されているデータセットでの言語モデルの学習と評価のための完全なフレームワークが含まれています。また、Appleデバイス上での推論と微調整のために、モデルをMLXライブラリに変換するコードもリリースします。この包括的なリリースは、オープンリサーチコミュニティを強化し、将来のオープンリサーチへの道を開くことを目的としているそうです。