Apple、ジェスチャー操作でアクションを発動したり、空間手描きなどを可能にするVision Frameworkの新機能を紹介

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

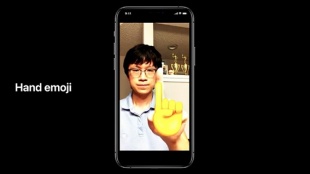

Appleが、WWDC20において「Detect Body and Hand Pose with Vision」を公開し、AppleのComputer Vision Frameworks担当マネージャーBrett Keating氏は、カメラで自撮りする場合、手でOKを示す形を作るとセルフタイマーが発動したり、手のポーズに合わせて変わる「ハンド絵文字」などが利用可能になると説明しています。

これらは、顔認識で使用するVision Frameworkのクラス「VNImageRequestHandler」で利用可能になります。

このポーズ認識を使用することで、ある決まったポーズをとった瞬間だけ写真撮影が出来たり、決められたポーズに合致した場合のみ写真撮影をすることで連続写真も撮影できると説明しています。

また、FaceTimeカメラを使用し、画面に直触れることなく手描きしたりできる「Hand Pose Detection」も利用可能になります。

多数の手がある場合、一番手前の手からどの数までの手を認識するかも決められます。

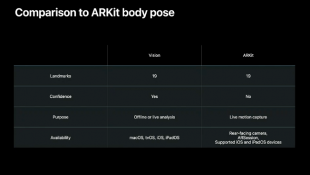

Create MLとVision Frameworkを組み合わせた場合、ARKitとランドマーク数は最大19箇所で同じですが、オフラインでも解析可能で、IOSおよびiPadOSの背面カメラを使用したライブモーションキャプチャーだけでなく、macOS、tvOS環境下のカメラであれば使用可能になるという汎用性があります。

サンプルコード「Building a Feature-Rich App for Sports Analysis」を使用することで、iOS 14のVisionとCore MLで利用可能ないくつかの新機能を確認することが出来るそうです。